UCenter(UC )后台备份数据库出现未知错误怎么办?

UCenter(UC )后台备份数据库出现未知错误怎么办?

2010/12/01 16:14 | by 刘新修 ]

2010/12/01 16:14 | by 刘新修 ]

一朋友站,ucenter+DZ6.1.0 迁移linux服务器后无法,UCenter 1.5.0+DZ6.1这样的组合就会在使用UC后台备份数据库的时候出现未知错误,无法使用ucenter进行备份,解决方法:

只要把UC目录下API目录里的dbbak.php文件复制到DZ6.1论坛里面的API目录下就可以解决问题了。

Centos-5.4下Webmin 的安装与使用

Centos-5.4下Webmin 的安装与使用

2010/11/17 17:41 | by 刘新修 ]

2010/11/17 17:41 | by 刘新修 ]

通过浏览器远程管理linux---webmin

Webmin是基于B/S(Browser/Server)模式的linux管理工具,可以进行linux的系统、服务器、网络、硬件、群集等管理,其界面友好,简明易用。只需通过浏览器,即可完成Linux的日常管理工作,是linux远程及本地管理的一把利剑。

http://www.webmin.com/download.html WEBMIN官方下载页面

TAR.GZ官方下载地址:

Unix tar/gzip format

http://prdownloads.sourceforge.net/webadmin/webmin-1.520.tar.gz 14M

1、 webmin的安装与使用

[root@yourhost /tmp]# gunzip webmin-1.520.tar.gz

[root@yourhost /tmp]# tar xf webmin-1.520.tar

[root@yourhost /tmp]# cd webmin-1.520

[root@yourhost /tmp/webmin-1.520]# ./setup.sh /usr/local/webmin

显示如下:

Config file directory [/etc/webmin]: //配置文件位置

Log file directory [/var/webmin]: //日志文件位置

Full path to perl (default /usr/bin/perl): //perl的位置(检测到后会提示成功)

Web server port (default 10000): //使用的端口(默认10000)

Login name (default admin): //登录名(默认admin)

Login password: //登录口令

Password again: //确认登录口令

Start Webmin at boot time (y/n): //是否在linux启动时自动启动webmin

上面所有提问,除了用户名及密码自定,其它均取默认值即可。

2、 webmin的启动与停止

webmin安装后以服务的形式运行(默认服务端口为:10000),启动与停止与其它服务类似。

启动:service webmin start

停止:service webmin stop

重启:service webmin restart

启动后用netstat -ant可看到10000端口已打开。)

3、访问webmin

访问方法:http://网址:10000

4、更改界面语言

进入界面后(见上图),点击第一个图标“Change Language and Theme”,进入后在第一行“Web UI language”后面选中“personal choice”,并在下拉列表中选择“simplified Chinese(ZH-CN)

单击“Make Changes”按钮,单击“Return to index”链接即可

5、webmin 管理员口令的更改

例:将webmin管理员root的口令更改为222222

changepass.pl /etc/webmin root 222222 (changepass.pl 位于解压的目录,复制到任何地方调用即可)

其中 /etc/webmin是配置文件的路径,即安装时定义的位置.

查看安装步骤全部:

http://at.liuxinxiu.com/2010/11/image/webmin-1.gif

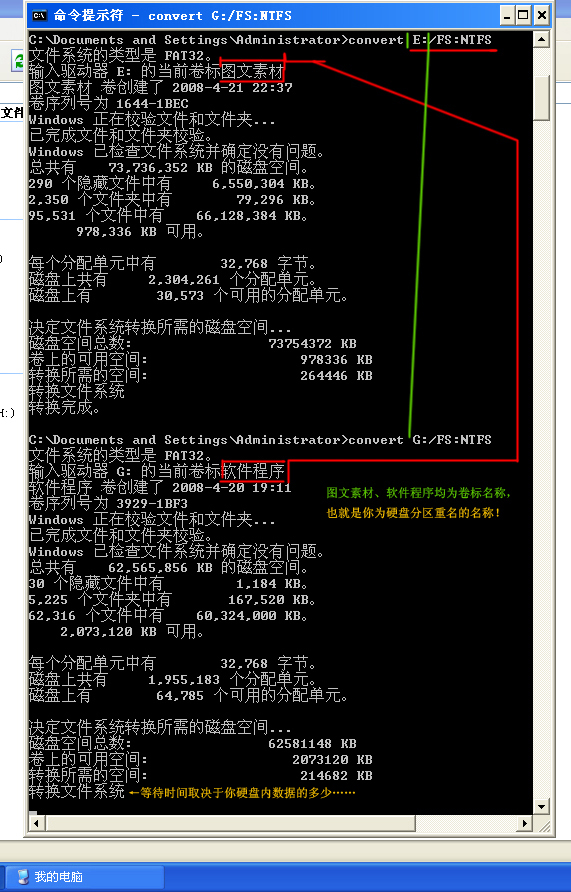

【原创】XP下将硬盘FAT32分区转为NTFS分区

【原创】XP下将硬盘FAT32分区转为NTFS分区

2010/11/16 20:29 | by 刘新修 ]

2010/11/16 20:29 | by 刘新修 ]

其实一条简单的指令就可以实现不破坏硬盘数据把FAT32转为NTFS分区。 点击屏幕左下角“开始”,找到运行,在其中输入:cmd,确定,打开“命令提示符”;在命令提示符下输入:

convert X:/FS:NTFS(其中X是盘符)。

执行后,重新启动电脑,进入系统以后,在查看磁盘属性就已经是NTFS格式了。

转载请标明出处:http://liuxinxiu.com/

【原创】FreeBSD下设置root用户异地登陆sshd(附:FreeBSD SSH配置详解)

【原创】FreeBSD下设置root用户异地登陆sshd(附:FreeBSD SSH配置详解)

2010/11/07 19:47 | by 刘新修 ]

2010/11/07 19:47 | by 刘新修 ]

本次教程使用的是:FreeBSD-8.1

修改freebsd下可以用sshd权限可允许普通用户登录ssh, 但不能用超级用户root用户登录的方法!

在/etc/ssh/sshd_config最后中加入

PermitRootLogin yes #允许root登录

PermitEmptyPasswords no #不允许空密码登录

PasswordAuthentication yes # 设置是否使用口令验证。

就可以了=========================================

之后再,vi编辑/etc/inetd.conf,去掉ssh前的#,保存退出 (开启监听ssh服务)

编辑/etc/rc.conf

最后加入:sshd_enable="yes"即可

最后激活sshd服务:

techo#/etc/rc.d/sshd start

用下面命令检查服务是否启动,在22端口应该有监听。

#netstat -an ## check port number 22

===================================================================

***********************************************************************************

##############################################

记得修改完配置文件后,重新启动sshd服务器(/etc/rc.d/sshd restart)即可。

几点补充说明

1,如果重启后还是不行请重新载入sshd_config 文件

/etc/rc.d/sshd reload

2,如果出现using keyboard-interactive authentication

password:

请确认PasswordAuthentication是否已经改成yes

另外如果客户端是putty那么请确认"尝试'智能键盘'认证(SSH-2)"的勾是否有去掉

3,如果是使用root帐号登陆

请确认密码是否为空

空密码无法登陆

4请确认是否有安装SSH

sysinstall>>>configure>>>networking>>>sshd是否的勾是否有打上

【原创】freeBSD更改系统root密码,注:root安装系统默认为空

【原创】freeBSD更改系统root密码,注:root安装系统默认为空

2010/11/07 19:26 | by 刘新修 ]

2010/11/07 19:26 | by 刘新修 ]

本次教程使用的是:FreeBSD-8.1

FreeBSD 5 之以后的版本,都按照如下步骤操作:

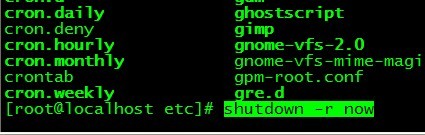

首先重启FreeBSD执行命令和linux一致:shutdown -r now

在系统启动提示以下画面时候按spacebar选择数字键:4 按enter进入单用户模式,图如下:

待系统运行至,提示以下信息时:

Enter full pathname of shell or RETURN for /bin/sh:

再按Enter进入单用户,提示

挂载档案系统,输入:

# fsck -p \\文件档案系统檢查

接下来开始重新设置root用户密码,输入:passwd 回车

# passwd \\更改密碼,

\\现New password: 时候键盘输入你想设置的密码,这里无*号提示,记住你输入密码的位数!

New password:

\\更改密碼,在出现Retype new password: 时候,键盘再次输入你上一步设置的密码!

Retype new password:

返回到以下界面说明设置成功!

之后输入:exit 退出,重新加载多用户。

# exit \\离开单用戶进入多用戶正常模式,再次启动系统,root用户使用新设置的密码进行登入!

==========================================================================

验证完成!root用户进入系统的画面@!

==========================================================================

freeBSD 比较早的版本使用以下步骤:

==========================================================================

重置root密码其实很简单

第一步:重启服务器,在出现模式选择时,选择单用户模式 选择 4(Boot FreeBSD in single user Mode) 系统出现提示,按回车确认继续

第二步:输入 fsck -y (检查系统文件) 磁盘检查完成后,挂载所有系统分区

第三步:输入 mount -a

第四步: 重设root用户密码 输入 passwd 回车 之后会提示再输入一遍,确认后 Ctrl+D 系统继续启动,就可以了.

------------------------------------------------------------------------------------------------------

Nginx简单的防盗链和带宽限制

Nginx简单的防盗链和带宽限制

2010/11/07 10:51 | by 刘新修 ]

2010/11/07 10:51 | by 刘新修 ]

很多时候,服务不是被用户流量击垮,而是被大量的对你没有任何贡献的盗链击倒,所以作为一个web站点防盗链是首先要考虑的问题,目前来说,对于各个web服务器,简单的防盗链方法多数是做rewrite,判断referer是否有效,当然高端的伪造referer的情况不在这里讨论。

在apache下,防盗链的方法有很多,你可以看看apache的日志,有多少是外部直接referer过来的,有可能比内部引用还多,尤其是图片和下载类站点更加明显。在apache下,最简单的防盗链使用类似这个形式:

SetEnvIfNoCase Referer "^http://www.google.com" local_ref=1

SetEnvIfNoCase Referer "^http://google.com" local_ref=1

<filesmatch "\.(txt|doc|mp3|zip|rar|jpg|gif)">

Order Allow,Deny

Allow from env=local_ref

或者在apache下使用RewriteEngine on,然后使用RewriteCond {HTTP_REFERER} 来定义,这些都是防止比较低级的盗链,如果是面对迅雷或者其他的话,这个远远不够,但是不是这里讨论的范围。

对于nginx而言,本身也有简单的防盗链模块ngx_http_referer_module,配置比较简单,定义文件类型:

location ~ .*\.(gif|jpg|jpeg|png|bmp|swf)$ {

valid_referers none blocked server_names *.163.com 163.com baidu.com;

if ($invalid_referer) {return 403;}

expires 30d;

}

具体的可以参考这里:http://wiki.nginx.org//NginxHttpLimitZoneModule,同时还有一个第三的防盗链相关模块,ngx_http_accesskey_module:

location /download {

accesskey on;

accesskey_hashmethod md5;

accesskey_arg "key";

accesskey_signature "mypass$remote_addr";

}

具体的使用方法:http://wiki.nginx.org//NginxHttpAccessKeyModule

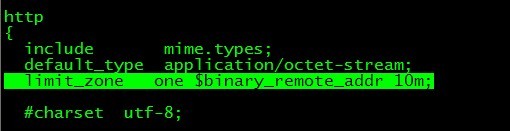

对于带宽限制,apache可以动态编译一些模块进去,mod_evasive20.so和mod_bw.so都是对防止简单的dos和带宽限制而存在的,而对于nginx,可以使用nginx的标准模块ngx_http_limit_zone_module,进行会话的并发连接数控制:

http {

limit_zone one $binary_remote_addr 10m;

#定义一个叫“one”的记录区,总容量为 10M,以变量 $binary_remote_addr 作为会话的判断基准(即一个地址一个会话)

...

server {

...

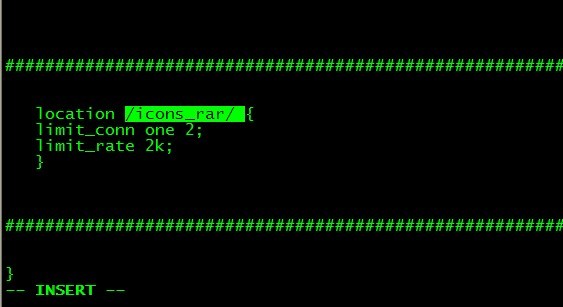

location /icons_rar/ {

limit_conn one 2;

limit_rate 2k;

}

limit_conn 一个会话只能进行两个连接。超过一个,则返回503。

imit_rate 来控制该目录的下载速度为2KB/S

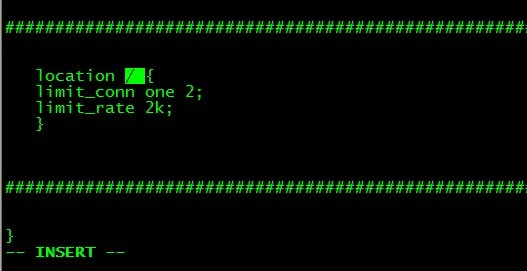

# 如果限制当前server内域名下所有目录下载显示则写 / 如:

server {

...

location / {

limit_conn one 2;

limit_rate 2k;

}

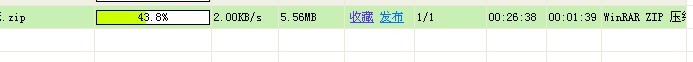

之后用迅雷下载文件测试:

这是简单的nginx的方案,更高级的应用应该是在客户端类型或者根据日志分析后,针对具体问题做文章,例如对$http_user_agent的特殊内容进行匹配,然后返回503。

为什么要返回503?如果直接返回403,有可能被下载工具发现,403的状态被认为被禁止了,然后进行调整继续作案。而返回一个503,对服务器来说影响不大,只占用一个nginx的线程而已。

先说到这里,以后再继续补充。

【原创】linux服务器更改DNS设置,Centos-5.4 让yum使用搜狐sohu镜像下载源

【原创】linux服务器更改DNS设置,Centos-5.4 让yum使用搜狐sohu镜像下载源

2010/10/30 13:43 | by 刘新修 ]

2010/10/30 13:43 | by 刘新修 ]

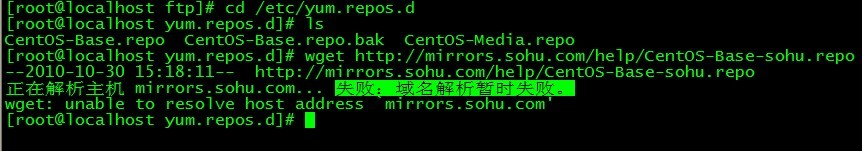

今日朋友买一北京VPS,本人帮其安装环境,先前YUM类库,出现无法解析域名,查看DNS设置得知问题所在。

粗心的机房管理员,设置好DNS也不测试下。

=============================================

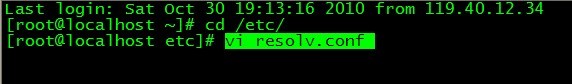

详细更改如下:

进入/etc/ 打开DNS设置文件

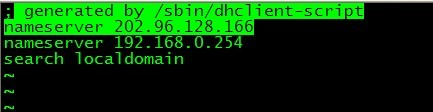

原来机房管理设置的DNS 202.96.128.166 为原来北京地区DNS经在本地WIN测试已经不可用!@

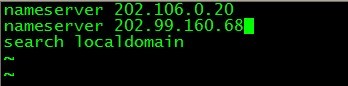

新设置为:202.106.0.20 / 202.99.160.68

主DNS:202.106.0.20 (北京DNS)

次DNS:202.99.160.68 (河北DNS)

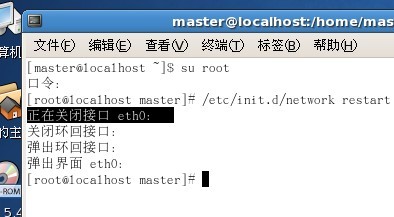

更改完成后,重启服务器即可,而不要使用重启网络配置命令:/etc/init.d/network restart

之所以不使用::/etc/init.d/network restart 重启网络命令是因为重启后会先关闭网络连接,此时SSH客户端已和服务器断开连接,导致启动服务无法发往服务器端。服务器所有网站将无法访问,SSH也无法连接@!

而选择重启服务器,再次启动机器时,会自动加载最新修改完的网络配置。

==================================================================

重启后,执行下载,可以完成!

之后删除 entOS-Base.repo 文件,或者备份成其他名称:

mv CentOS-Base.repo CentOS-Base.repo.bak

*****************************************

重命名:CentOS-Base-sohu.repo 为:CentOS-Base.repo

mv CentOS-Base-sohu.repo CentOS-Base.repo

*******************************************

现在使用 yum 就会选择国内搜狐开源镜像站!@

推荐 yum使用的CENTOS 国内镜像站点,单CD安装CENTOS

推荐 yum使用的CENTOS 国内镜像站点,单CD安装CENTOS

2010/10/29 10:45 | by 刘新修 ]

2010/10/29 10:45 | by 刘新修 ]

centos官方镜像列表

http://www.centos.org/modules/tinycontent/index.php?id=32

CENTOS 国内镜像

http://mirrors.163.com/centos/ (浙江省杭州市 电信,武汉电信访问快,竟提供最新的4.7及5.2)

http://mirrors.shlug.org/centos/ (上海市电信真如IDC机房,武汉电信访问慢)

http://mirrors.ta139.com/centos/ (移动线路,武汉电信访问快)

http://centos.ustc.edu.cn/centos/ (中国科学技术大学,教育网线路 -官方镜像)

http://mirror.centos.net.cn/ (北京市 网通, -官方镜像)

--------------------------------------------------------------------------------

CentOS USTC mirror

http://centos.ustc.edu.cn/centos/

--------------------------------------------------------------------------------

安装CentOS 4的方法:

下载CentOS-4.7.ServerCD.iso 单张光盘安装CentOS4.7,安装后可以用yum update升级,适合服务器使用

安装后请按照以下步骤修改CenOS-Base.repo,以后就可以方便的用yum安装软件了.

cd /etc/yum.repos.d

mv CentOS-Base.repo CentOS-Base.repo.save

wget http://centos.ustc.edu.cn/CentOS-Base.repo

修改以上文件后, 如需要安装gcc, 直接yum install gcc就可以了

--------------------------------------------------------------------------------

安装CentOS 5的方法:

下载centos/5.2/isos/i386/CentOS-5.2-i386-netinstall.iso,刻盘安装CentOS5.2,安装地方 设置为HTTP,Server centos.ustc.edu.cn, 目录 为centos/5.2/os/i386。

安装后请按照以下步骤修改CenOS-Base.repo,以后就可以方便的用yum安装软件了.

cd /etc/yum.repos.d

mv CentOS-Base.repo CentOS-Base.repo.save

wget http://centos.ustc.edu.cn/CentOS-Base.repo.5

mv CentOS-Base.repo.5 CentOS-Base.repo

为Centos5添加网易163、Sohu的yum源

为Centos5添加网易163、Sohu的yum源

2010/10/27 00:13 | by 刘新修 ]

2010/10/27 00:13 | by 刘新修 ]

将yum的目标服务器更改为中国大陆服务器镜像

以下的URL地址我都验证过了在当前完全可以下载,而且速度挺快.

mv /etc/yum.repos.d/CentOS-Base.repo /etc/yum.repos.d/CentOS-Base.repo.bak

vi /etc/yum.repos.d/CentOS-Base.repo

- # CentOS-Base.repo

- #

- # This file uses a new mirrorlist system developed by Lance Davis for CentOS.

- # The mirror system uses the connecting IP address of the client and the

- # update status of each mirror to pick mirrors that are updated to and

- # geographically close to the client. You should use this for CentOS updates

- # unless you are manually picking other mirrors.

- #

- # If the mirrorlist= does not work for you, as a fall back you can try the

- # remarked out baseurl= line instead.

- #

- #

- [base]

- name=CentOS-$releasever - Base

- baseurl=http://mirror.be10.com/centos/$releasever/os/$basearch/

- http://ftp.iasi.roedu.net/mirrors/centos.org/$releasever/os/$basearch/

- http://ftp.ncnu.edu.tw/Linux/CentOS/$releasever/os/$basearch/

- http://ftp.hostrino.com/pub/centos/

- gpgcheck=1

- gpgkey=http://mirror.centos.org/centos/RPM-GPG-KEY-centos4

- #released updates

- [update]

- name=CentOS-$releasever - Updates

- baseurl=http://mirror.be10.com/centos/$releasever/os/$basearch/

- http://ftp.iasi.roedu.net/mirrors/centos.org/$releasever/os/$basearch/

- http://ftp.ncnu.edu.tw/Linux/CentOS/$releasever/os/$basearch/

- http://ftp.hostrino.com/pub/centos/

- gpgcheck=1

- gpgkey=http://mirror.centos.org/centos/RPM-GPG-KEY-centos4

- #packages used/produced in the build but not released

- [addons]

- name=CentOS-$releasever - Addons

- baseurl=http://mirror.be10.com/centos/$releasever/os/$basearch/

- http://ftp.iasi.roedu.net/mirrors/centos.org/$releasever/os/$basearch/

- http://ftp.ncnu.edu.tw/Linux/CentOS/$releasever/os/$basearch/

- http://ftp.hostrino.com/pub/centos/

- gpgcheck=1

- gpgkey=http://mirror.centos.org/centos/RPM-GPG-KEY-centos4

- #additional packages that may be useful

- [extras]

- name=CentOS-$releasever - Extras

- baseurl=http://mirror.be10.com/centos/$releasever/os/$basearch/

- http://ftp.iasi.roedu.net/mirrors/centos.org/$releasever/os/$basearch/

- http://ftp.ncnu.edu.tw/Linux/CentOS/$releasever/os/$basearch/

- http://ftp.hostrino.com/pub/centos/

- gpgcheck=1

- gpgkey=http://mirror.centos.org/centos/RPM-GPG-KEY-centos4

- #additional packages that extend functionality of existing packages

- [centosplus]

- name=CentOS-$releasever - Plus

- baseurl=http://mirror.centos.org/centos/$releasever/centosplus/$basearch/

- gpgcheck=1

- enabled=0

- gpgkey=http://mirror.centos.org/centos/RPM-GPG-KEY-centos4

- #contrib - packages by Centos Users

- [contrib]

- name=CentOS-$releasever - Contrib

- baseurl=http://mirror.centos.org/centos/$releasever/contrib/$basearch/

- gpgcheck=1

- enabled=0

- gpgkey=http://mirror.centos.org/centos/RPM-GPG-KEY-centos4

=======================================================================

或者直接下载SOHU 163 开源镜像服务器的配置文件到当前目录:

或者直接下载163 SOHU 镜像服务区

====================================

wget http://mirrors.163.com/.help/CentOS-Base-163.repo

wget http://mirrors.sohu.com/help/CentOS-Base-sohu.repo

yum makecache

yum update

【原创文章】更改windows2003默认的用户名,及其修改用户密码(图解)

【原创文章】更改windows2003默认的用户名,及其修改用户密码(图解)

2010/10/22 17:13 | by 刘新修 ]

2010/10/22 17:13 | by 刘新修 ]

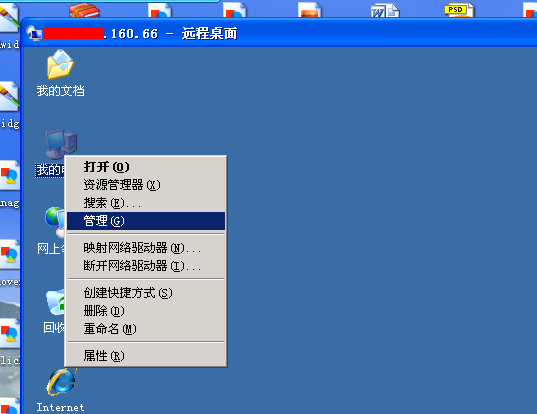

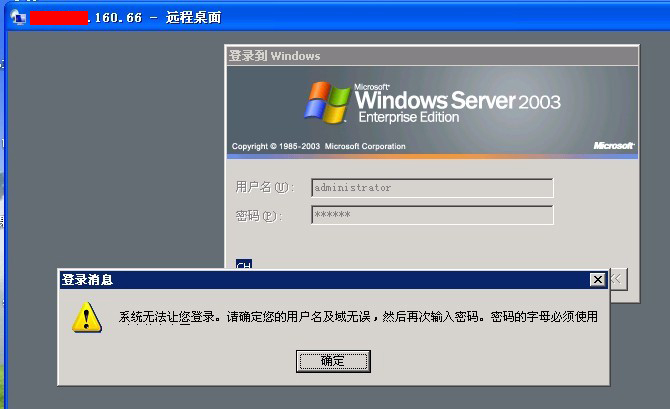

今天有个朋友问我修改2003服务器系统默认的administrator帐号的方法,现在写出来和大家分享下。

一种方法是按"开始"--"运行" 输入: gpedit.msc

然后在"计算机配置"--"windows设置"--"安全设置"--"本地策略"--"安全选项" 那里

找到最下面的"帐号:重命名系统管理员帐号"那里改用户名.在"交互式登陆:不显示上一次的用户名"设置为"启用".

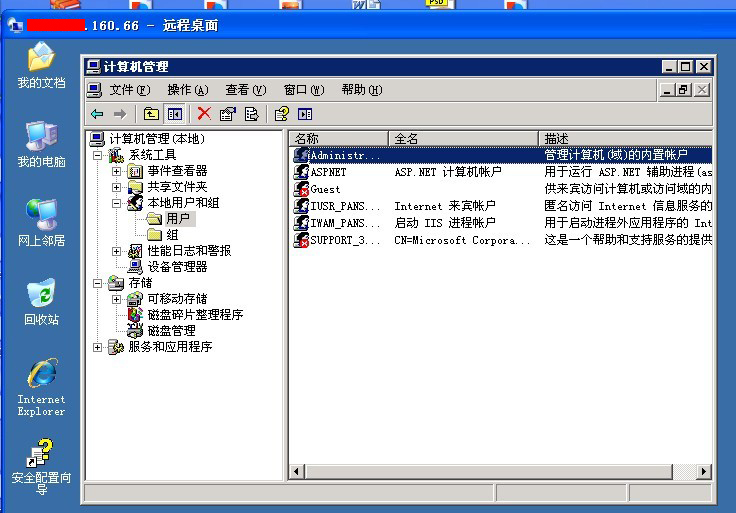

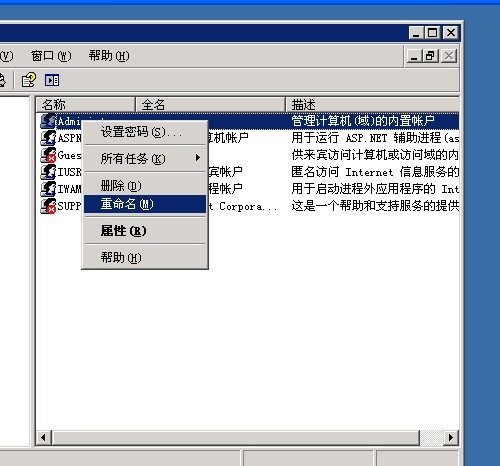

或者可以打开“我的计算机”--“控制面板”---“用户帐户”--“本地用户和组”---“用户”--“administrator”--右键单击“administrator”--选择“重命名”----在出现的名称设置框中,设置新的管理员名称----输入新的用户名。

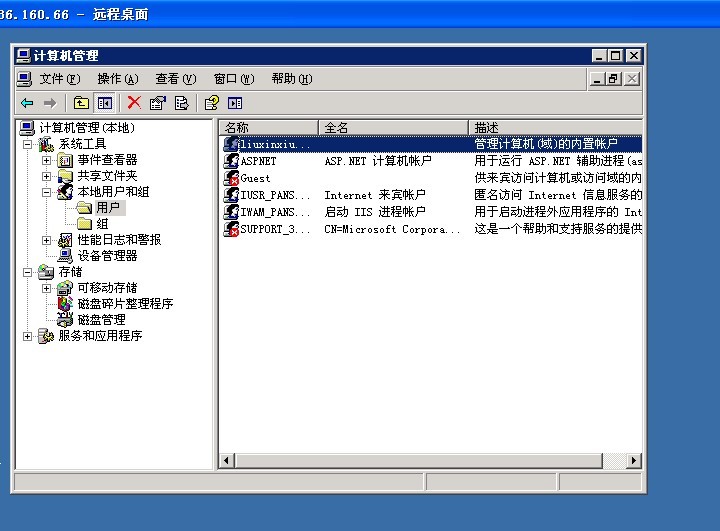

重新启动系统,就可生效@!

原来2003默认管理帐号:administartor 已经无法登入!

使用新修改后的帐号(liuxinxiu.com)和密码(liuxinxiu.com)进行登入!

=========================================================================

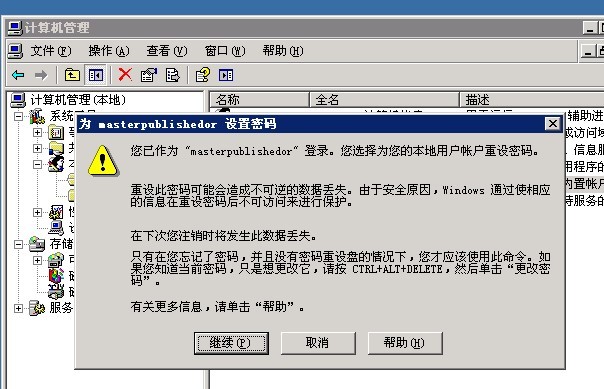

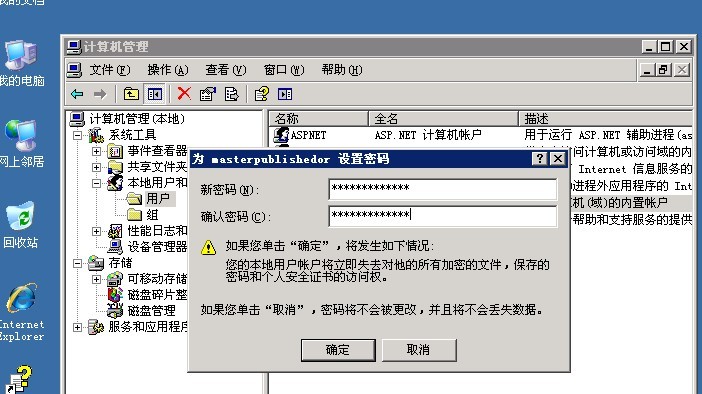

具体修改密码的方法如下:

重复输入2次新密码点击:“确定” 然后重新启动系统!就可生效!@

改服务器密码对安全还是很有必要的,要是服务器用默认帐号密码简单,用穷举法很容易破解管理员权限。

修改windows2003默认远程桌面端口号【文章】:http://liuxinxiu.com/3389